在移動設備和嵌入式系統中,Mali GPU憑借其優異的能效比,已成為圖形渲染與通用計算的關鍵組件。將計算密集型的二維浮點矩陣運算(如矩陣乘法、卷積等)遷移至Mali GPU執行,能顯著提升性能并降低CPU負載。本文將深入探討Mali GPU的編程特性,并結合實戰技巧,詳細解析針對二維浮點矩陣運算的并行優化策略。

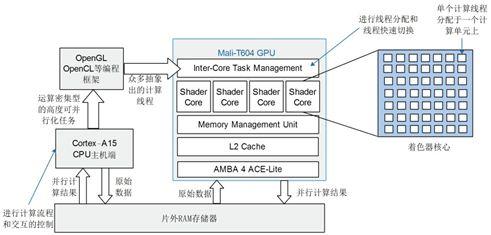

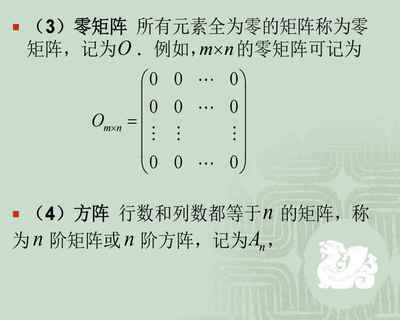

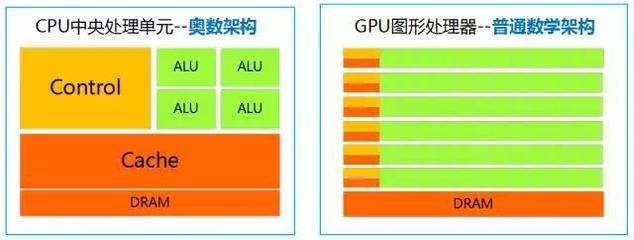

一、Mali GPU核心架構與編程模型特性

Mali GPU通常采用基于瓦片(Tile-Based)的渲染架構,其計算核心由著色器核心(Shader Core)組成。在編程層面,主要支持OpenCL ES(用于通用計算)和Vulkan(兼顧圖形與計算)兩種API。關鍵特性包括:

- 分層內存體系:包括私有內存(Private Memory,線程獨享)、本地內存(Local Memory,工作組內共享)和全局內存(Global Memory,所有線程可見)。優化數據在各級內存間的移動是性能關鍵。

- SIMD/SIMT執行模型:Mali GPU通過單指令多線程(SIMT)方式執行,一個線程束(通常是4個線程)同步執行相同指令但處理不同數據。

- 工作組(Work-Group)調度:計算任務被劃分為工作組,在著色器核心上調度執行。合理的工作組大小對隱藏訪存延遲至關重要。

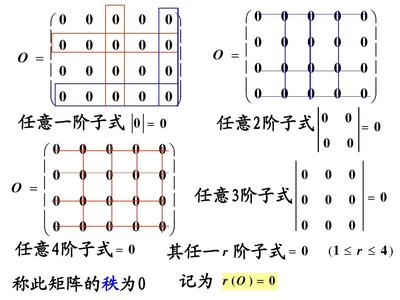

二、二維浮點矩陣運算的并行化分解策略

以矩陣乘法C = A × B(假設維度均為N×N)為例,經典的優化思路是:

- 線程映射:將輸出矩陣C的每個元素(或一個小塊)的計算分配給一個獨立的GPU線程。這樣可生成N×N個并行任務,實現大規模并行。

- 工作組劃分:將輸出矩陣劃分為若干二維塊(如16×16或32×32),每個塊由一個工作組負責計算。工作組內線程通過本地內存協作,高效復用從全局內存讀取的A和B矩陣數據塊。

- 循環分塊(Tiling)優化:由于單個元素計算需要訪問A的一整行和B的一整列,直接實現會導致大量重復的全局內存訪問。優化方法是:將計算分解為多個階段,在每個階段,工作組先將A的一個子塊和B的一個子塊從全局內存加載到快速的本地內存中,然后所有線程基于這些子塊進行部分和累加。這能極大減少昂貴的全局內存訪問次數。

三、針對Mali GPU的關鍵優化技巧

- 優化內存訪問模式:

- 合并訪問(Coalesced Access):確保工作組內連續的線程訪問全局內存中連續(或具有規則步長)的地址。例如,在讀取矩陣A的塊時,讓線程0讀取A(0,0),線程1讀取A(1,0)... 這樣多次訪問可被合并為一次更寬的內存事務,大幅提升帶寬利用率。

- 充分利用本地內存:將頻繁訪問的共享數據(如矩陣的特定行/列塊)載入本地內存。Mali GPU的本地內存延遲遠低于全局內存,是性能提升的核心。

- 向量化數據類型:使用

float4、float8等向量類型進行加載、存儲和計算。這能更有效地利用內存帶寬和ALU單元。

- 調整工作組配置:

- 工作組大小:通常設置為二維,如(16, 16)或(8, 8),并使其總大小(256或64)是GPU硬件線程束大小的整數倍,且符合OpenCL ES的設備限制。這有助于提高計算資源的占用率。

- 工作項(Work-Item)分工:除了為每個輸出元素分配一個線程的基本模式,還可以讓一個線程負責計算一個小型矩陣塊(如2×2),以減少線程創建開銷并增加指令級并行。

- 指令級優化與注意事項:

- 減少寄存器壓力:Mali GPU每個著色器核心的寄存器數量有限。應避免在內核中使用過多私有變量,或通過循環展開時謹慎控制展開因子,以防寄存器溢出導致性能下降。

- 平衡計算與訪存:通過增加每個線程的計算量(如計算更大的輸出塊)來分攤固定的內存訪問開銷,提升計算訪存比。

- 精度選擇:根據需求,可考慮使用

mediump(中等精度)浮點數進行計算,這在Mali GPU上通常更快且功耗更低,但需評估精度損失是否可接受。

四、實戰優化流程與性能評估

- 基線實現:首先實現一個簡單的、每個線程計算一個輸出元素的核函數,作為性能基準。

- 引入循環分塊與本地內存:實現利用本地內存緩存數據塊的版本,觀察性能提升。

- 優化內存訪問模式:調整線程的數據讀取順序,確保合并訪問;嘗試使用向量化加載。

- 微調參數:系統性地調整工作組大小、循環分塊大小、每個線程負責的輸出區域大小等參數,找到針對特定Mali型號和矩陣尺寸的最優組合。

- 性能分析工具:利用Arm Mobile Studio中的Streamline或Mali Offline Compiler等工具,分析內核的硬件計數器(如緩存命中率、ALU利用率、內存帶寬),定位瓶頸。

在Mali GPU上優化二維浮點矩陣運算,精髓在于最大化數據復用、最小化全局內存訪問、以及保持硬件執行單元的高占用率。通過深刻理解其瓦片式架構和內存層次,并靈活運用循環分塊、向量化、工作組優化等技巧,開發者能夠充分釋放Mali GPU的并行計算潛力,為移動端AI推理、圖像處理等應用帶來顯著的性能加速。